IA de Intel incluida en mochila ayuda a personas con discapacidad visual

El desarrollador de Inteligencia Artificial (IA) Jagadish K. Mahendran y su equipo diseñaron una mochila con tecnología de inteligencia artificial, activada por voz, que puede ayudar a las personas que viven con alguna discapacidad visual a navegar y percibir el mundo que los rodea, explicó Intel en un comunicado.

Agregó que la mochila ayuda a detectar letreros de tráfico, obstáculos suspendidos, cruces peatonales, objetos en movimiento y elevaciones cambiantes, todo mientras se ejecuta en un dispositivo interactivo de bajo consumo de energía.

Agregó que la mochila ayuda a detectar letreros de tráfico, obstáculos suspendidos, cruces peatonales, objetos en movimiento y elevaciones cambiantes, todo mientras se ejecuta en un dispositivo interactivo de bajo consumo de energía.

“El año pasado, cuando me reuní con un amigo que vive con una discapacidad visual, me impresionó la ironía de que mientras yo enseño a robots a ver, hay mucha gente que no puede ver y necesita ayuda. Esto me motivó a construir el sistema de asistencia visual con el kit de IA con profundidad (OAK-D) de OpenCV, impulsado por Intel”, comentó Mahendran, del Instituto para la Inteligencia Artificial de la Universidad de Georgia.

La Organización Mundial de la Salud estima que a nivel mundial, 285 M de personas viven con discapacidad visual. Por el momento, los sistemas de asistencia visual para navegación son limitados y oscilan de aplicaciones de smartphones asistidas por voz, basadas en el Sistema de Posicionamiento Global (GPS), a soluciones de bastones inteligentes activados por cámara. Estos sistemas carecen de la percepción de profundidad necesaria para facilitar la navegación independiente, detalló la compañía.

Cómo funciona

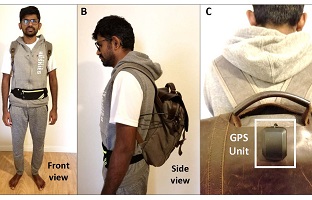

El sistema está alojado dentro de una mochila que contiene una unidad de cómputo central, parecida a una computadora portátil. En un chaleco se encuentra oculta una cámara, y en una cangurera la batería capaz de proporcionar aproximadamente ocho horas de uso. Se puede añadir una cámara de inteligencia artificial espacial Luxonis OAK-D al chaleco o la cangurera, y después conectarla a la unidad de cómputo de la mochila. Tres pequeños agujeros en el chaleco sirven como ventanas de visualización para la OAK-D, que está colocada en el interior del chaleco.

La unidad OAK-D es un dispositivo de IA que se ejecuta en la VPU Intel Movidius y el kit de herramientas Distribution of OpenVINO para inferencia de IA de edge en chip. Tiene la capacidad de ejecutar redes neuronales avanzadas mientras proporciona funciones de visión por computador acelerada y un mapa de profundidad en tiempo real desde su par estereofónico, así como información de color desde una sola cámara 4k, abundó Intel.

Un auricular habilitado por Bluetooth permite que el usuario interactúe con el sistema a través de consultas y comandos de voz, y el sistema responde con información verbal. A medida que el usuario se desplaza en su entorno, el sistema transmite audiblemente información sobre los obstáculos comunes, que incluyen letreros, ramas de árboles y peatones. También advierte sobre cruces peatonales, banquetas, escaleras y vías de acceso próximos, puntualizó Intel.

Más información: Kit de herramienta Intel OpenVINO | Inteligencia artificial en Intel | Video sobre la mochila con IA

WhatsApp eSemanal 55 7360 5651